AI 系统落地难的,从来不只是模型:一次企业级部署实施复盘

这两年,关于大模型、RAG、私有化部署的讨论越来越多。 但真正进入企业场景之后会发现,项目能不能落地,往往并不取决于模型本身,而取决于另一套更基础、也更容易被忽视的能力:基础设施规划、中间件协同、服务编排,以及最终的可交付性。

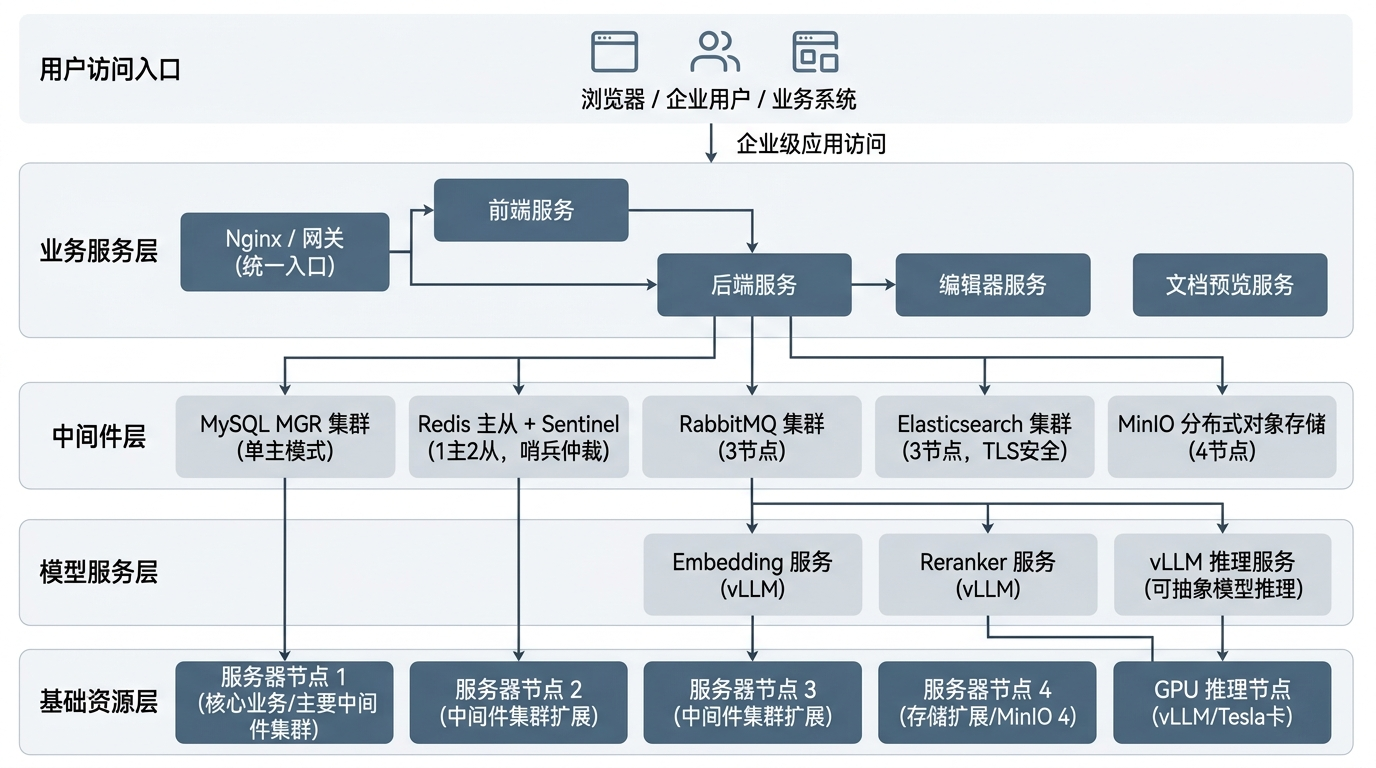

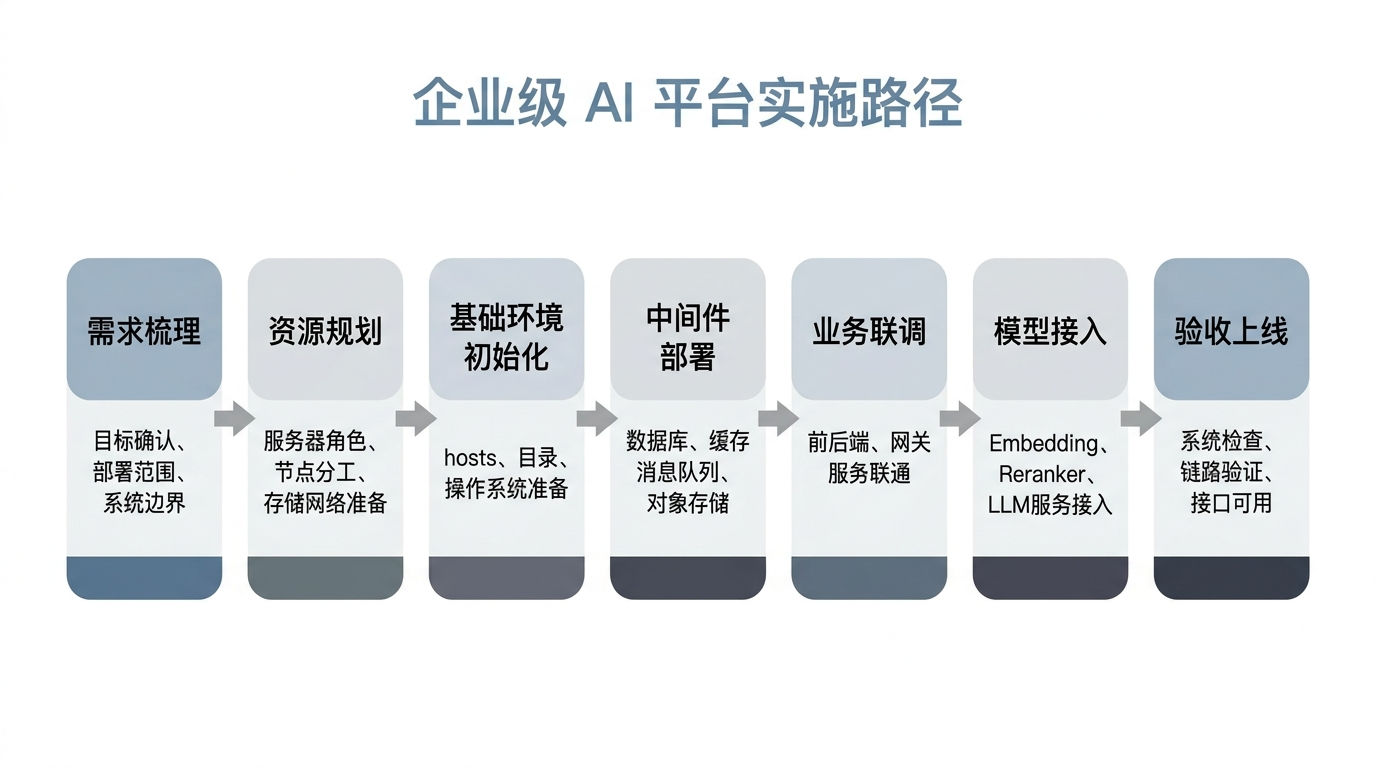

前段时间,我参与完成了一次企业级 AI 平台的部署实施。 这不是一个简单的测试环境,也不是把几个容器拉起来就结束,而是一套面向实际使用场景的系统落地工作:从服务器资源规划,到对象存储、数据库、缓存、消息队列、搜索服务的集群部署,再到业务服务编排、模型服务接入,最后形成完整的验收链路。

回头看这个项目,我最大的感受是:

AI 项目真正难的地方,往往不在“某个组件会不会装”,而在“能不能把一整套系统有条理地落下来,并让它具备后续运行和维护的基础”。

一、项目现场里,真正复杂的往往不是某个组件,而是整体协同

单看技术栈,这次项目里涉及的内容并不陌生:

- 对象存储

- MySQL 高可用

- Redis 主从与哨兵

- RabbitMQ 集群

- Elasticsearch 集群与安全

- 业务服务编排

- 模型推理服务接入

这些技术单独拿出来看,都有相对成熟的实践。 但一旦进入真实环境,它们就不再是彼此独立的组件,而是要共同组成一套能被业务系统真正使用的底座。

这个过程中,通常会遇到几类典型问题:

第一类,是资源角色如何划分。 哪些节点承担核心服务,哪些节点承担集群扩展,哪些节点需要独立给模型服务使用,这些都直接影响后续稳定性。

第二类,是组件之间的依赖顺序。 对象存储、数据库、缓存、消息队列、搜索服务、业务服务、模型服务,启动顺序和验证路径一旦混乱,问题就会被叠加,排查成本会迅速上升。

第三类,是**“能启动”和“能交付”之间的差距**。 服务起来了,并不等于系统可用。只有业务链路跑通、关键状态可验证、异常时知道从哪里看起,这套系统才算真正进入可交付状态。

所以从项目角度看,这类工作真正需要解决的,不是单点安装,而是把多层能力组织成一个有序系统。

二、一次完整落地,首先是“资源和角色”的问题

这次实施里,我最先处理的,并不是具体某个组件,而是服务器角色和整体布局。

原因很简单: 如果资源规划不清晰,后面所有服务都可能互相影响。尤其是在企业环境里,数据库、缓存、消息队列、搜索、对象存储、业务服务、模型服务同时存在时,节点分工必须尽早明确。

从结果来看,这套部署更接近一种典型的企业级分工方式:

- 一部分节点承担核心服务和主要中间件

- 一部分节点承担集群扩展与副本角色

- 一部分节点补足对象存储的分布式能力

- 独立的推理节点承接模型服务

这种划分的意义,不只是为了“看起来像集群”,而是为了让后续每一类服务都有更清晰的边界:

- 数据服务更稳定

- 存储能力更可扩展

- 业务容器不与模型服务过度争抢资源

- 故障排查时更容易缩小范围

很多时候,系统是否稳定,决定因素不是某条命令,而是前期这些不太起眼的规划动作。

三、比部署本身更重要的,是中间件集群如何形成稳定底座

这次项目里,中间件层是整个系统的基础。 如果这一层不稳,业务服务和模型链路再完整,也很难长期运行。

1. 对象存储:不是附件仓库,而是业务底层能力的一部分

在 AI 平台里,对象存储的作用远不止“存文件”。 知识库原始文档、处理后的中间产物、系统上传内容,很多都会依赖这层能力。

因此在实际部署中,我更关注的是:

- 节点之间的统一性

- 存储路径规划是否一致

- 集群模式是否清晰

- 健康检查是否方便

- 后续 bucket 和访问方式是否易于维护

也正因为如此,对象存储更像是整套系统的数据底板,而不是一个独立的小功能。

2. 数据库:高可用不是口号,而是运行方式的选择

数据库层采用什么模式,直接决定后续维护成本和业务风险。

在这次项目里,数据库方案更偏向于一种兼顾一致性、管理复杂度和业务接入方式的设计。 重点不在于把模式堆得多复杂,而在于:

- 节点角色明确

- 主从关系清晰

- 故障时便于判断

- 后续备份和恢复路径可执行

在企业环境里,这种“适度复杂、但足够可控”的思路,通常比追求表面上的高级架构更实用。

3. Redis 和消息队列:系统越往后走,越离不开它们的稳定性

缓存和消息系统,往往是上线之后最容易被低估、又最容易暴露问题的部分。

一旦业务链路变长,任务异步化、状态缓存、消息传递都会成为关键环节。 因此从实施层面看,更重要的是:

- 主从结构是否清楚

- 状态是否可观察

- 节点间切换逻辑是否成立

- 配置是否足够标准化

- 发生异常时是否容易定位

这类能力平时不一定显眼,但一旦系统进入持续运行阶段,它们的价值会很快体现出来。

4. 搜索服务:真正棘手的,不是启动,而是逐步走向可用

搜索服务在 AI 系统里通常不是“可有可无”的增强项,而是影响检索效果、知识组织能力和业务体验的重要一环。

这部分实施给我的一个很深感受是: 复杂组件最好分阶段推进。

先把节点连通和集群状态跑通,再逐步补齐安全配置、证书、插件、权限控制。 这样做的好处是,每一步都能验证,每一步都能回退,不容易把问题全部搅在一起。

很多项目不是做不到,而是在实施顺序上给自己制造了额外难度。

四、业务真正跑起来,才算完成了“从组件到系统”的转换

中间件集群部署完成后,项目其实只完成了一半。 真正决定交付质量的,是业务服务能否顺利建立在这套底座之上。

这次实施里,业务层并不是单一服务,而是多个服务协同:

- 统一入口

- 前端页面

- 后端服务

- 编辑器服务

- 文档预览能力

它们对底层中间件都有不同程度的依赖。 因此从联调过程来看,真正重要的是:

- 服务之间的调用链是否清晰

- 网关转发是否准确

- 文档、存储、检索、任务链路是否可打通

- 异常时能否迅速判断问题在入口层、服务层还是中间件层

做到这里,系统才从“基础设施已完成”真正走向“业务可以开始使用”。

五、模型服务是否独立,往往决定了后续扩展空间

这次项目里,还有一个比较关键的部分,是模型服务的接入方式。

在不少场景中,Embedding、Reranker 这类服务是 AI 平台不可或缺的一环。 而它们一旦接入真实业务,通常就会面临几个现实问题:

- GPU 资源如何分配

- 与业务容器是否会互相影响

- 端口与接口如何管理

- 后续是否方便替换模型

- 性能瓶颈出现时,问题归属是否清楚

基于这些考虑,模型服务更适合独立部署在专门的推理节点上。 这种方式未必最省资源,但通常更利于:

- 业务层和模型层解耦

- 资源隔离

- 后续扩容

- 模型替换或升级

- 性能问题定位

从长期看,这种边界感会让整套系统更容易维护。

六、真正决定项目成熟度的,往往是“有没有完整验收链路”

做完这次项目之后,我更明确地意识到: 部署工作最容易被忽略、但又最能体现专业度的部分,其实是验收设计。

很多时候,系统部署完成之后,如果没有一套清晰的检查路径,后续就会陷入一种模糊状态: 看起来服务都在,但不知道是不是都真正正常; 页面能打开,但不知道链路是不是完整; 组件在线,但不知道谁出了问题该先查哪里。

因此这次项目里,我特别看重全链路验证。 也就是说,最终不是一句“已经部署好了”,而是需要有一套明确的检查思路,覆盖:

- 对象存储集群状态

- 数据库成员状态

- Redis 主从与哨兵状态

- 消息队列集群状态

- 搜索服务节点状态

- 业务容器状态

- 页面访问状态

- 模型接口返回情况

这套验收路径的意义在于,它既服务于上线前检查,也服务于后续维护。 对于实际运行的系统来说,这一点往往比部署动作本身更重要。

七、这次项目也让我重新理解了“落地”这件事

如果只是看技术栈,这样的项目似乎可以被拆成很多独立任务。 但真正做下来会发现,决定结果的往往不是某一个技术点,而是整体推进方式:

- 前期有没有把资源和角色分清楚

- 实施顺序是否合理

- 中间件有没有形成稳固底座

- 业务服务有没有真正建立在底座之上

- 模型服务有没有留出独立空间

- 最后有没有形成可检查、可维护、可延续的验收路径

从这个角度看,“落地”并不是一个简单动作,而是一套系统性的组织过程。 它要求技术方案、实施动作、排查能力和最终交付之间形成闭环。

这也是为什么我越来越觉得,AI 系统到了企业现场之后,真正比拼的往往不是谁更会讲概念,而是谁能把一套复杂系统稳定地推进到可用状态。

八、写在最后

这次项目对我来说,更像是一次很完整的实践复盘。

一方面,它再次印证了一个很现实的判断: AI 系统落地难的,从来不只是模型,而是模型之外那一整套基础能力。

另一方面,它也让我更关注一件事: 很多项目的价值,不只是“完成部署”,而是把部署过程逐渐沉淀成一套可以复用的方法和判断。

把这些内容整理出来,并不是为了把一个项目写成操作手册,而是希望把其中更有共性的部分提炼出来。 对于正在推进类似工作的团队来说,也许这些经验能提供一些参考。

后面如果有机会,我也会继续把这类企业级部署、系统联调和交付过程中的一些实践,做更系统的整理和记录。

评论功能

当前站点为 GitHub Pages 镜像版本,不支持评论功能。

如需发表评论,请访问主域名版本:

🚀 前往 主域名 版本评论